Audio in auto come in cuffia e in cuffia come se non le si indossasse: le novità al CES 2019

Sentire l'audio in auto come se si fosse in cuffia, con zone personalizzate per ciascun occupante e dall'altro lato sentire audio in cuffia come se provenisse da un sistema surround da 13 altoparlanti. Questo e molto altro nelle demo che abbiamo visto al CES di Las Vegas

di Roberto Colombo pubblicato il 04 Febbraio 2019 nel canale Audio VideoSonyCreativeHarmanHondaAudeze

Suono in cuffia come se non ci fosse

Altro tema legato all'audio è un ossimoro rispetto a quello raccontato nei primi paragrafi di questo articolo: se lì si parlava di indirizzare il suono di altoparlanti nelle orecchie come se giungesse da cuffie in-ear, Sony e Creative sono al lavoro per far sentire il suono delle cuffie come se provenisse da fonti esterne. Questo è uno di quei problemi che assilla gli audiofili: anche le cuffie con la più ampia scena sonora non riescono a riprodurre la spazialità dei suoni dal vivo, ma non arrivano nemmeno a quella simulata dagli altoparlanti posti a una certa distanza dall'ascoltatore.

Esistono già oggi diverse tecnologie di virtualizzazione e di posizionamento 3D dei suoni, ma il problema è che non può esistere una soluzione unica che vada bene per tutti. Come ogni particolare anatomico, anche le orecchie sono uniche per ogni singola persona e pure diverse tra loro. Al pari delle impronte digitali e dei tratti del viso, potrebbero essere utilizzate per stabilire l'identità di una persona. In particolare il padiglione auricolare esternamente è composto da due parti ricurve, l'elice - più esterna - l'antielice - più interna. Vi sono due sporgenze, chiamate trago e antitrago, che tendono a coprire il meato acustico esterno; la conca, poi, è la regione concava da cui si accede al condotto uditivo esterno. Tutti questi tessuti, con la loro forma, influenzanno il modo con cui un individuo sente. In particolare elice e antielice sono responsabili del posizionamento dei suoni nello spazio. HRTF (Head related transfer functions): questo il nome delle funzioni che ricostruiscono il modo in cui l'orecchio umano percepisce i suoni in arrivo. Le nostre orecchie con la loro forma modificano il suono (creando rimbalzi e assorbimenti) e il nostro cervello basandosi sul'intensità di arrivo e al tempo di arrivo riesce a ricostruire la direzione di provenienza dei suoni e la loro distanza.

Entrambe le tecnologie dei due produttori si focalizzano proprio su questo aspetto per una virtualizzazione efficace e un posizionamento tridimensionale dei suoni che possa apparire 'reale' nella ricostruzione percettiva che ne fa il nostro cervello. Due sono, principalmente, i modi per capire il profilo unico uditivo dei singoli individui. Uno più semplice, ma meno preciso, è quello di ricostruirlo in base alla forma delle orecchie. L'altro, più complesso, richiede di inserire nelle orecchie dei microfoni e poi lanciare dei segnali campione e 'sentire' esattamente come l'orecchio di quella persona.

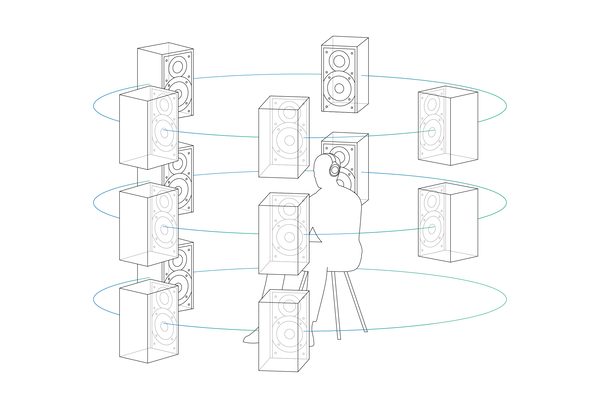

Entrambe le tecnologie funzionano già benissimo utilizzando questo secondo metodo, che era al centro delle dimostrazioni al CES di Las Vegas. In entrambi i casi mi sono stati dati dei microfoni, molto simili ad auricolari in-ear, da posizionare nelle orecchie, e poi, mentre tenevo la testa ben dritta e lo sguardo fisso verso lo schermo davanti a me, sono stati lanciati dei segnali campione attraverso gli altoparlanti tutto intorno alla stanza, con diverse frequenze, posizionamento e spostamento nello spazio. Da questi dati è stato ricostruito il mio profilo uditivo, da utilizzare poi nella riproduzione dei suoni in cuffia per ingannare il mio cervello e fargli percepire il suono dei driver a pochi centimetri dalle orecchie come proveniente dall'esterno.

In entrambi i casi i risultati sono stupefacenti: durante la demo Creative Super X-Fi confesso di aver tolto le cuffie convinto che il suono del sound-check posizionale (front, front right, rear right e via dicendo) arrivasse dagli altoparlanti esterni. Invece era solo nelle mie cuffie. Entrambe le tecnologie possono essere già utilizzate per rendere molto più realistica l'esperienza di ascolto in cuffia di contenuti con audio posizionale 5.1 o 7.1 e per offrire un ascolto di semplici brani stereo, ma con la sensazione che provengano dall'esterno delle cuffie, come se esse fossero completamente trasparenti dal punto di vista acustico e la musica fosse emessa da altoparlanti in una stanza.

Visto che l'approccio di creazione del profilo HRTF personale tramite microfoni e segnali campione è difficilmente replicabile a casa, i due brand hanno scelto di utilizzare quello basato sulle immagini di orecchie e volto per gli utenti finali.

Simile tecnologia, approccio diverso per quanto riguarda l'arrivo sul mercato con dei prodotti. Il più semplice è quello di Creative, che infatti è già sul mercato con dei prodotti tra cui l'interessantissimo Creative SXFI Amp, un piccolo DAC/AMP di dimensioni ridottissime, con interfaccia USB-C. Proprio questo apparecchio è stato il protagonista della dimostrazione. Il mio profilo è stato caricato nella memoria del dispositivo e poi si è partiti con il test di ascolto. Il DAC/AMP offre controlli per il volume, per l'arresto/avvio delle tracce e per attivare e disattivare la funzione che dona spazialità al suono. Il dispositivo richiede uno smartphone Android con l'app installata per la creazione del profilo tramite foto di viso e orecchie e per caricare i dati HRTF sull'amplificatore portatile. Una volta caricato il profilo esso risiede nel dispositivo e può essere utilizzato con qualunque dispositivo compatibile. Tra essi gli smartphone Android con supporto USB OTG, con connettore USB-C o MicroUSB (in confezione c'è l'adattatore), PC/Mac con cavo USB A->C e iPhone e iPad inframezzando un cavo Lightning USB-C.

L'app offre anche diversi profili di equilizzazione ottimizzati per alcune cuffie molto diffuse (Sennheiser, Sony, Hifiman, Beyerdynamic) e 'certificati SX-Fi' delle cuffie Creative e E-MU (marchio acquisito dalla stessa Creative qualche tempo fa): l'utente può caricare un profilo alla volta nelle cuffie. Esso verrà utilizzato (come per quello HRFT) su tutti i dispositivi. Anche un profilo personalizzato di equalizzazione può essere impostato. Creative ha fornito un SXFI Amp per successive recensioni con il profilo personalizzato registrato al CES e quello creato tramite le foto auricolari: vi racconterò in dettaglio prossimamente come si comporta. È un ottimo DAC/AMP, ma la funzione Super X-Fi ha bisogno ancora di qualche rifinitura, l'esperienza di ascolto è molto diversa (e meno soddisfacente) di quella avuta durante la dimostrazione.

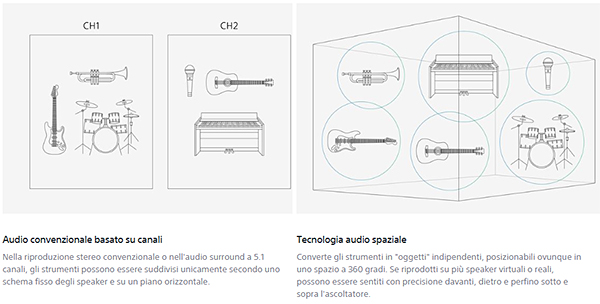

Sony punterà a un approccio completamente diverso e per raccontarlo ha chiamato sul palco della conferenza stampa un artista del calibro di Pharrell Williams, che nei mesi scorsi è volato in Giappone per provare in anteprima la tecnologia Sony 360 Reality Audio, rimanendone decisamente colpito. "Fatelo, fatelo subito" è stato il suo commento a caldo. L'idea di Sony è quella da un lato di mettere la tecnologia a disposizione delle major per rimasterizzare i brani anche in un formato di audio posizionale a oggetti (Object-Based Audio).

Un approccio similare a quello per l'audio dei film nei formati Dolby Atmos e DTS:X, ma Sony punta a creare uno standard aperto basato su codec MPEG-H 3D Audio, con la possibilità di avere fino a 24 oggetti con bitrate di circa 1,5 Mbps. La posizione degli oggetti audio sarà decisa dagli artisti in fase di masterizzazione e non sarà modificabile. L'esperienza in cuffia dovrebbe riuscire a replicare quella ottenibile da un set di 13 altoparlanti fisici.

Questo formato, essendo aperto, potrà essere utilizzato da tutte le app che saranno rese compatibili (i software di riproduzione musicale ad esempio), dai servizi di streaming e anche dai produttori di hardware per creare sistemi compatibili. Non sarà necessario avere un hardware dedicato. Secondo quanto detto da Sony, sarà la qualità della creazione del profilo a fare la differenza tra i diversi sistemi e qui Sony crede di poter fare la differenza. Anche nel caso di Sony per crearlo sarà necessario scattare le immagini delle orecchie.

Terzo tipo di manipolazione spaziale del suono è quella applicata da Audeze alle sue cuffie Mobius, dedicate al pubblico dei videogiocatori. Fino all'inizio del 2018 la gamma del produttore si era concentratta sulle cuffie musicali per audiofili, ma nel marzo scorso Audeze ha lanciato una campagna di crowdfunding su Indiegogo per creare un prodotto con un target completamente differente. Sono così nate Audeze Mobius, cuffie sempre basate su diaframmi magnetici planari da 100mm e risposta in frequenza che va da 10 Hz a 50 KHz, ma indirizzate ai videogamer. In questo caso il DPS Cipher integrato nelle cuffie lavora in accoppiata agli accelemrometri e manipola il suono in modo che i suoni vengano sempre dalla stessa direzione indipendentemente dalla posizione della testa. La funzione di head tracking è disponibile su PC e Mac utilizzando l'apposito programma fornito con le cuffie, sia con connnessione USB sia in modalità wireless via Bluetooth 5.0. Le cuffie permettono di emulare i principali impianti surround (2.0, 2.1, 5.0, 5.1, 7.1) dopo una calibrazione iniziale la prima volta che le si indossa.

In sintesi il tema dell'audio è stato decisamente trasversale al CES 2019, proponendo interessanti novità pronte per il mercato e che probabilmente entreranno presto nella vita di tutti i giorni, sia per migliorare la nostra vita in auto, sia per rendere più reale l'ascolto di musica in cuffia.

Si è cominciato a parlare di auto a guida autonoma troppo presto: il responso del CES 2019

Si è cominciato a parlare di auto a guida autonoma troppo presto: il responso del CES 2019 Recensione DOOM: The Dark Ages, proiettili e heavy metal nel Medioevo

Recensione DOOM: The Dark Ages, proiettili e heavy metal nel Medioevo ASUS ROG Astral RTX 5090 overclock: spremere il massimo da Blackwell e GDDR7

ASUS ROG Astral RTX 5090 overclock: spremere il massimo da Blackwell e GDDR7 Recensione OPPO Reno13 FS vs OPPO A5 Pro 5G: chi è il migliore e perché?

Recensione OPPO Reno13 FS vs OPPO A5 Pro 5G: chi è il migliore e perché? Il primo test con equipaggio della navicella indiana Gaganyaan di ISRO sarà nel 2027

Il primo test con equipaggio della navicella indiana Gaganyaan di ISRO sarà nel 2027 La missione Artemis II, con equipaggio, potrebbe essere lanciata già a febbraio 2026

La missione Artemis II, con equipaggio, potrebbe essere lanciata già a febbraio 2026 La sonda spaziale sovietica Kosmos-482 rientrerà domani, 10 maggio, sulla Terra: niente panico!

La sonda spaziale sovietica Kosmos-482 rientrerà domani, 10 maggio, sulla Terra: niente panico! Meta pensa ancora alle stablecoin dopo Libra/Diem: pagamenti internazionali per i creator

Meta pensa ancora alle stablecoin dopo Libra/Diem: pagamenti internazionali per i creator Ex direttore creativo di Ubisoft: 'La mancanza di innovazione sta uccidendo i giochi AAA'

Ex direttore creativo di Ubisoft: 'La mancanza di innovazione sta uccidendo i giochi AAA' Svizzera, le-ID torna al voto: referendum sull'identità digitale elettronica

Svizzera, le-ID torna al voto: referendum sull'identità digitale elettronica Xiaomi 15, il top di gamma con lenti Leica e HyperAI: ora disponibile a 799 invece di 999 su Amazon

Xiaomi 15, il top di gamma con lenti Leica e HyperAI: ora disponibile a 799 invece di 999 su Amazon Trovaprezzi vs Google: chiesti 3 miliardi di euro di risarcimento per concorrenza sleale

Trovaprezzi vs Google: chiesti 3 miliardi di euro di risarcimento per concorrenza sleale Fiat Topolino guida il mercato dei quadricicli elettrici e a maggio abbassa ancora il prezzo

Fiat Topolino guida il mercato dei quadricicli elettrici e a maggio abbassa ancora il prezzo Trump abolisce il Digital Equity Act: "è una legge razzista e illegale"

Trump abolisce il Digital Equity Act: "è una legge razzista e illegale" Europa Universalis 5, annunciato il nuovo strategico con un video di 30 minuti

Europa Universalis 5, annunciato il nuovo strategico con un video di 30 minuti Possibile cessione di Italdesign da parte di Audi: i sindacati esprimono preoccupazione

Possibile cessione di Italdesign da parte di Audi: i sindacati esprimono preoccupazione Indiana Jones e l'Antico Cerchio ottiene la certificazione Steam Deck: arriva anche un nuovo hotfix

Indiana Jones e l'Antico Cerchio ottiene la certificazione Steam Deck: arriva anche un nuovo hotfix "La caccia a Gollum": il nuovo film de Il Signore degli Anelli arriva al cinema! Data, trama e regia

"La caccia a Gollum": il nuovo film de Il Signore degli Anelli arriva al cinema! Data, trama e regia

2 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoPiumati

sapevo che ci fossero dei polli in giro sotto mentite spoglie, ma quì si supera ogni immaginazione. neanche fosse il primo aprile. io non so quanti tecnici audio conoscete e se ne conoscete, ma questi giochini si facevano ai tempi del macintosh II. quando non si conosce un argomento si richiede una consulenza a chi ne sa. se vi interessa vi posso indicare chi ne sa di audio (registrazione-postproduzione-effetti ecc....) non stò nemmeno a dirvi quello che ho capito io dai vari demo perchè il mio pensiero è poca cosa. in tutti i casi le VS piume sono molto lunghe.Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".